- DONALD

- SPRAWA DEEPFAKE’A Z NAGĄ UCZENNICĄ BYŁA IGNOROWANA PRZEZ TYLE SŁUŻB, ŻE TRAFIŁA DO PROKURATORA GENERALNEGO

Sprawa deepfake’a z nagą uczennicą była ignorowana przez tyle służb, że trafiła do prokuratora generalnego

27.11.2025, 13:30

fot. Shutterstock / East News

Prezes

Urzędu Ochrony Danych Osobowych

poinformował w rozmowie z PAP, że zwrócił się do Waldemara Żurka, ministra sprawiedliwości i prokuratora generalnego z prośbą o reakcję w sprawie

deepfake'a przedstawiającego wizerunek nagiej uczennicy.

Jak stwierdził, mimo zgłoszeń szkoły i rodziców pokrzywdzonej, prokuratura i policja odmówiły wszczęcia działań w tej sprawie.

Mirosław Wróblewski w Studiu PAP mówił dziś m.in. o konieczności zapewnienia odpowiednich

podstaw prawnych

do radzenia sobie z wyzwaniami związanymi z funkcjonowaniem sztucznej inteligencji. Jak stwierdził,

obecne rozwiązania nie gwarantują ochrony prawnej

np. osobom pokrzywdzonym deepfake'ami, szczególnie w aspekcie wykorzystywania wizerunku.

-

Obecne rozwiązania nie gwarantują efektywnej ochrony, one są szczątkowe

- stwierdził, dodając, że chodzi m.in. o sytuacje, kiedy deepfake wykorzystywany jest do oszustwa.

- Przepisy prawa autorskiego, przepisy o ochronie dóbr osobistych, a nawet przepisy prawa karnego nie pokrywają tych sytuacji - tłumaczył.

Dodał, że problem ze stosowaniem tych przepisów mają również służby.

- Ja się borykam

z odmowami ze strony policji i prokuratury,

właśnie chociażby dlatego, że jest trudność w interpretacji dostosowania do tych przepisów, więc wyraźna regulacja w tym zakresie byłaby czymś pożądanym - mówił.

Prezes UODO przytoczył sprawę

deepfake'a, w którym wykorzystano wizerunek uczennicy w jednej ze szkół.

W czerwcu złożył w tej sprawie zawiadomienie na policję.

Zaakceptuj pliki cookies Twitter/X, aby zobaczyć ten tweet.

-

Na podstawie zdjęcia uczennicy wygenerowano do tego wizerunek nagiej postaci, rozpowszechniano go w szkole i namawiano innych do upowszechnienia tego

- mówił dziś o sprawie, która do niego trafiła.

- Mocno przesadzili młodzi ludzie i naprawdę wydaje się, że środki dyscyplinujące z ustawy o postępowaniu wobec nieletnich są konieczne w tym przypadku.

Wnosiła o szkoła i rodzice pokrzywdzonej,

niestety nie dostrzeżono znamion żadnego czynu [zabronionego - red.].

- Zwróciłem się do prokuratora generalnego, ministra sprawiedliwości o skorzystanie z jego uprawnień i

bardzo liczę na to, że pan minister Żurek podejdzie z rozwagą i troską do tego problemu

- dodał.

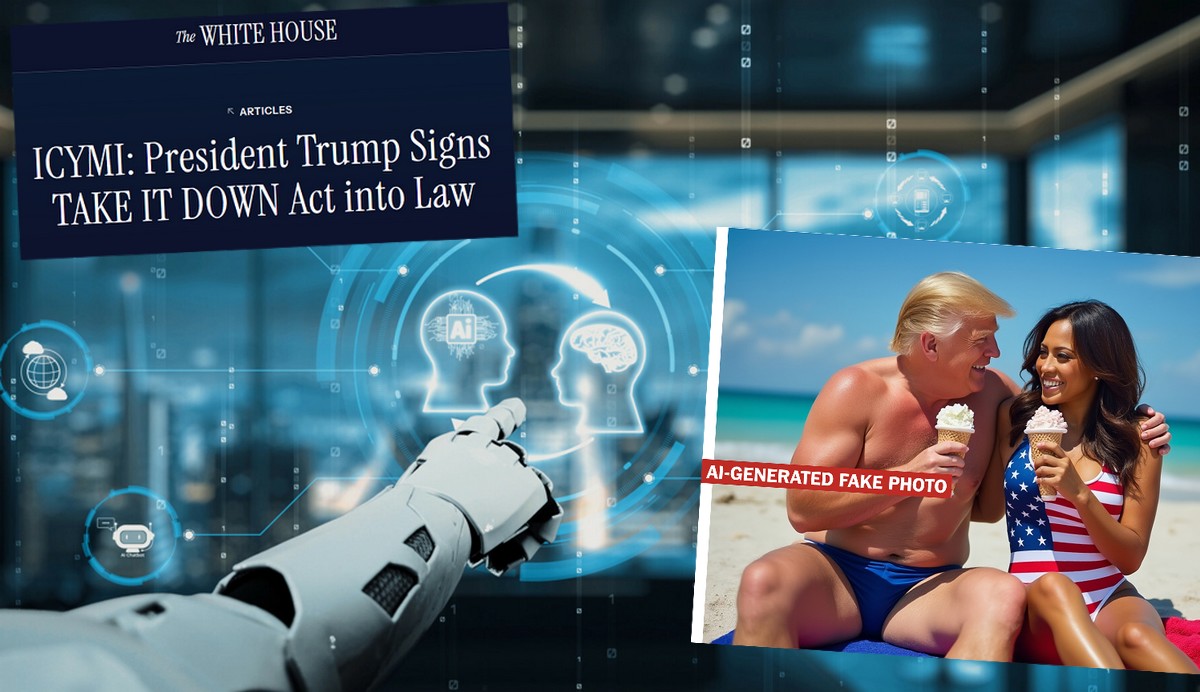

Problem niedostosowania polskiego prawa do obecnych realiów dotyczących AI prezes UODO podejmował już wcześniej. We wrześniu

zwrócił się do ministra cyfryzacji Krzysztofa Gawkowskiego z apelem o stworzenie prawa chroniącego przed negatywnym wpływem deepfake'ów.

"Obecne regulacje nie są dostosowane do specyfiki oraz możliwości technologii deepfake i treści generowanych przez sztuczną inteligencję, a także ich możliwości negatywnego odziaływania na ludzi. Zmiany prawne są konieczne, gdyż technologia deepfake pozwala tworzyć nagrania, wideo i audio, które wydają się autentyczne, choć takimi nie są. Sama technologia jest neutralna i może służyć do tworzenia np. efektów specjalnych w filmach, jednak

może prowadzić do nadużyć, w tym naruszania praw i wolności ludzi na niespotykaną dotychczas skalę

" - czytamy w komunikacie UODO z września.

Wśród zagrożeń, jakie niesie ze sobą technologia deepfake wymieniono wykorzystywanie wizerunku danej osoby bez jej wiedzy i zgody oraz kradzież tożsamości. Jak podkreślono, technologia ta może posłużyć także do szantażu i nękania, gdyż umożliwia ukazanie osoby w sytuacjach, które w rzeczywistości nie miały miejsca.

"Obecne prawo tylko w pewnym obszarze chroni wykorzystywanie wizerunku. Przepisy ustawy o prawie autorskim i prawach pokrewnych wymagają zgody na rozpowszechnianie wizerunku, a Kodeks cywilny reguluje ochronę dóbr osobistych, w tym wizerunku i głosu. Z kolei RODO traktuje wizerunek jako dane osobowe wymagające ochrony. Jeśli weźmiemy pod uwagę Kodeks karny to wykorzystanie deepfake może wypełniać znamiona np. czynu zabronionego kradzieży tożsamości (art. 190a § 2), zmuszania do określonego zachowania (art. 191), rozpowszechnienia wizerunku nagiej osoby bez zgody (art. 191a), publicznej prezentacji lub produkcji, rozpowszechniania, przechowywania i posiadania treści pornograficznych (art. 202), zniesławienia lub zniewagi (art. 212 i 216) lub oszustwa (art. 286)" - wskazywał prezes UODO.

W jego ocenie

żadna z tych regulacji prawnych nie zapewnia jednak narzędzi do pełnej i skutecznej ochrony przed skutkami takich nadużyć

, np. poprzez szybkie usuwanie nielegalnych materiałów.

"Tymczasem skutki tych nadużyć we współczesnym świecie zdominowanym przez internet i media społecznościowe są niezwykle dotkliwe, identyfikowanie twórców deepfake’ów często bardzo utrudnione, a procedury sądowe trwają zbyt długo" - podkreślono.

Zaakceptuj pliki cookies Twitter/X, aby zobaczyć ten tweet.

Hej, przypominamy tylko:

1. Szanujemy nawet ostrą dyskusję i wolność słowa, ale nie agresję. Przemocowe treści będą usuwane.

2. W komentarzach można swobodnie używać embedów z mediów społecznościowych.

3. Polecamy założenie konta, dzięki temu możesz zobaczyć wszystkie swoje dyskusje w jednym miejscu i dodać coś (👉 Sortownia), co trafi na stronę główną.

4. Jeżeli chcesz Donalda bez reklam, dołącz do naszych patronów: https://patronite.pl/donaldpl

Źródła:

Pokaż więcej (3)Polecane posty z Sortowni

Popularne dzisiaj

Wygląda na to, że frakcja harcerzy odłącza się od PiS, a rozstanie nie przebiega w dobrych relacjach

21

"Większość kierownictwa PiS z zaniepokojeniem przyjęła informacje o powstawaniu stowarzyszenia Morawieckiego". Zobacz więcej »

Prezydent krytykowany za powołanie do Rady Nowych Mediów prorosyjskiego youtubera

51

Mężczyzna miał także postawione zarzuty za uprawę marihuany. Zobacz więcej »

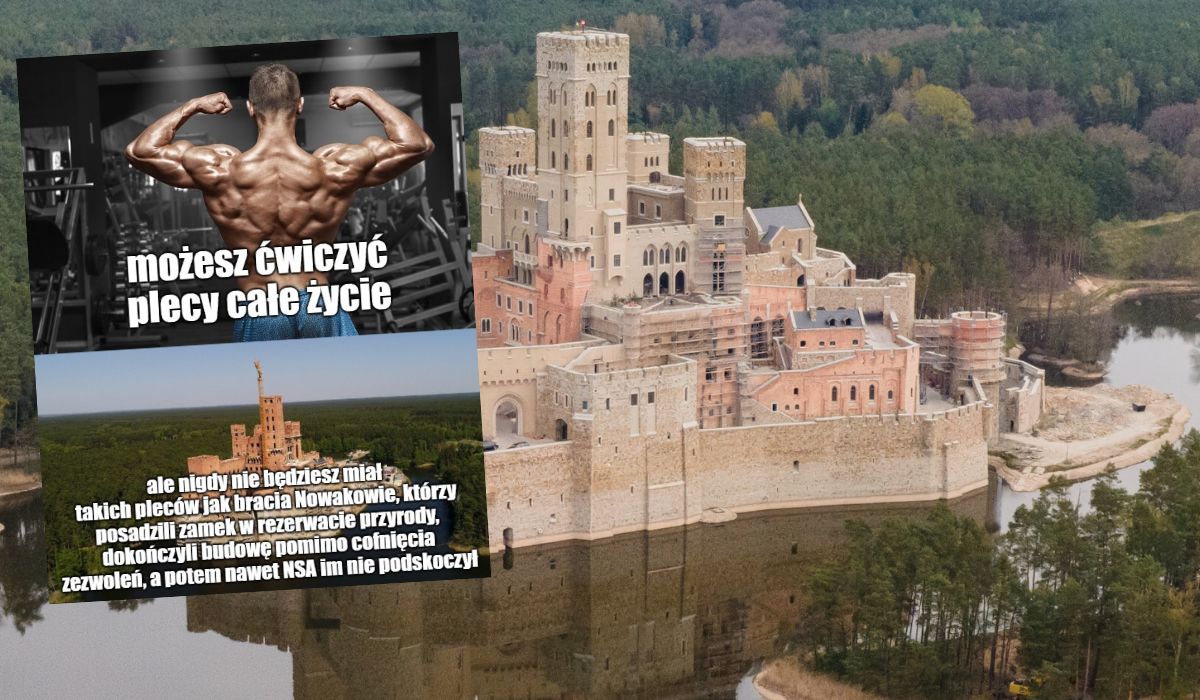

NSA ostatecznie uznał, że zgoda na budowę "Twierdzy Deweloperskiej" w Stobnicy jest legalna

24

To koniec ostatniego postępowania administracyjnego w tej sprawie. Zobacz więcej »

Zandberg krytykuje Czarnka za chęć sprowadzania imigrantów do Polski

20

"W poważnym państwie kontrolę nad migracją ma rząd, nie biznes". Zobacz więcej »