- DONALD

- TWITTER JEDNAK BĘDZIE BANOWAĆ UŻYTKOWNIKÓW, KTÓRZY WSTAWIAJĄ TREŚCI ZROBIONE W AI BEZ OZNACZEŃ

Twitter jednak będzie banować użytkowników, którzy wstawiają treści zrobione w AI bez oznaczeń

07.03.2026, 16:00

Fot. East News

Nikita Bier,

menadżerka ds. produktu platformy X

, zapowiedziała, że użytkownicy, którzy publikują na swoich profilach

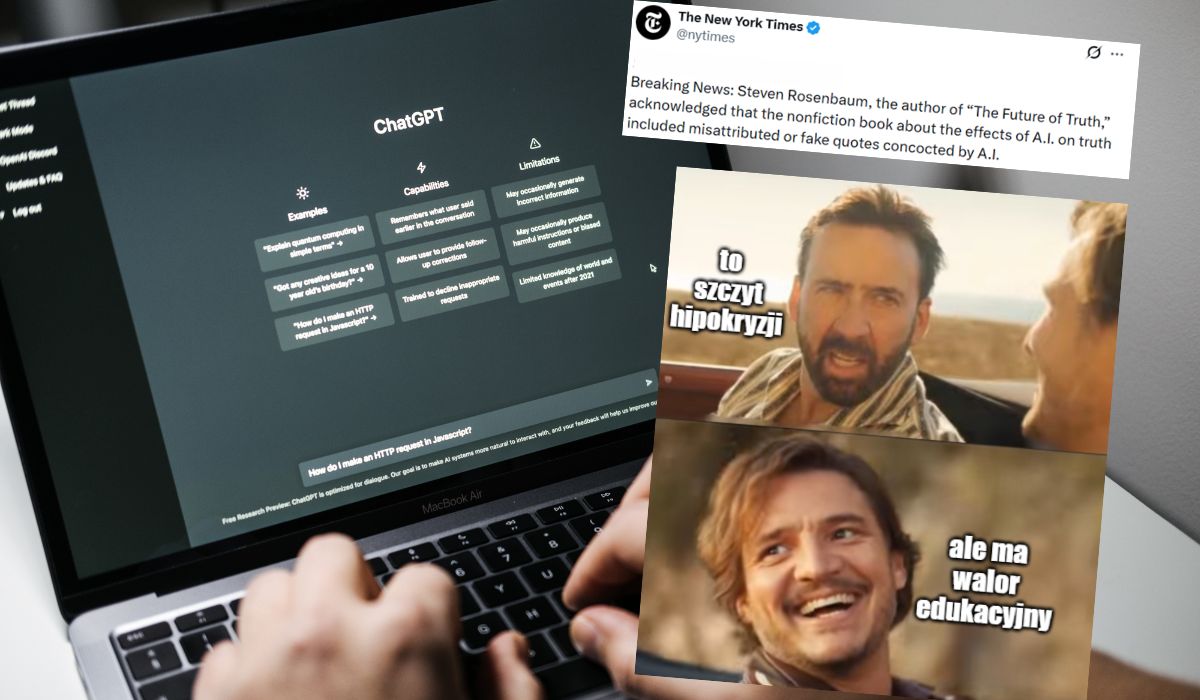

wygenerowane przez sztuczną inteligencję

nagrania z konfliktów zbrojnych,

stracą możliwość zarabiania na platformie.

To następstwo wysypu fejków związanych z wojną amerykańsko-irańską.

- W czasie wojny, krytycznie ważne jest, żeby ludzie mieli dostęp do autentycznych informacji. Przy pomocy współczesnych technologii AI, trywialnie proste jest stworzenie treści, która może zmylić użytkowników - powiedziała Bier zapowiadając zmiany w polityce platformy.

W ostatnich dniach

platformę X zalały fejki na temat wojny z Iranem

- viralem stały się m.in. nagrania, na których płonie znany hotel Burj Khalifa czy przedstawiające zestrzelenie amerykańskiego myśliwca przez irański pocisk.

- Nawet jeśli obrazy wygenerowane przez sztuczną inteligencję są niskiej jakości lub widać na nich znak wodny, często widzimy, że są szeroko udostępniane - sama ilość fejków i łatwość, z jaką są generowane, jest powodem do zmartwień - powiedział Steve Nowottny, redaktor organizacji fact-checkingowej Full Fact.

Zgodnie z zapewnieniami X, użytkownicy rozpowszechniający fejki na swoich kontach

najpierw stracą na 90 dni możliwość monetyzowania swoich wpisów na platformie

w ramach programu Creator Revenue Sharing.

Recydywa będzie karana permanentnym banem

.

Warto zauważyć, że sam właściciel platformy X, Elon Musk, szeroko promuje rozwój sztucznej inteligencji i zachęca użytkowników do jak najczęstszego korzystania z Groka, AI działającego w ramach Twittera.

Hej, przypominamy tylko:

1. Szanujemy nawet ostrą dyskusję i wolność słowa, ale nie agresję. Przemocowe treści będą usuwane.

2. W komentarzach można swobodnie używać embedów z mediów społecznościowych.

3. Polecamy założenie konta, dzięki temu możesz zobaczyć wszystkie swoje dyskusje w jednym miejscu i dodać coś (👉 Sortownia), co trafi na stronę główną.

4. Jeżeli chcesz Donalda bez reklam, dołącz do naszych patronów: https://patronite.pl/donaldpl

Polecane posty z Sortowni

Popularne dzisiaj

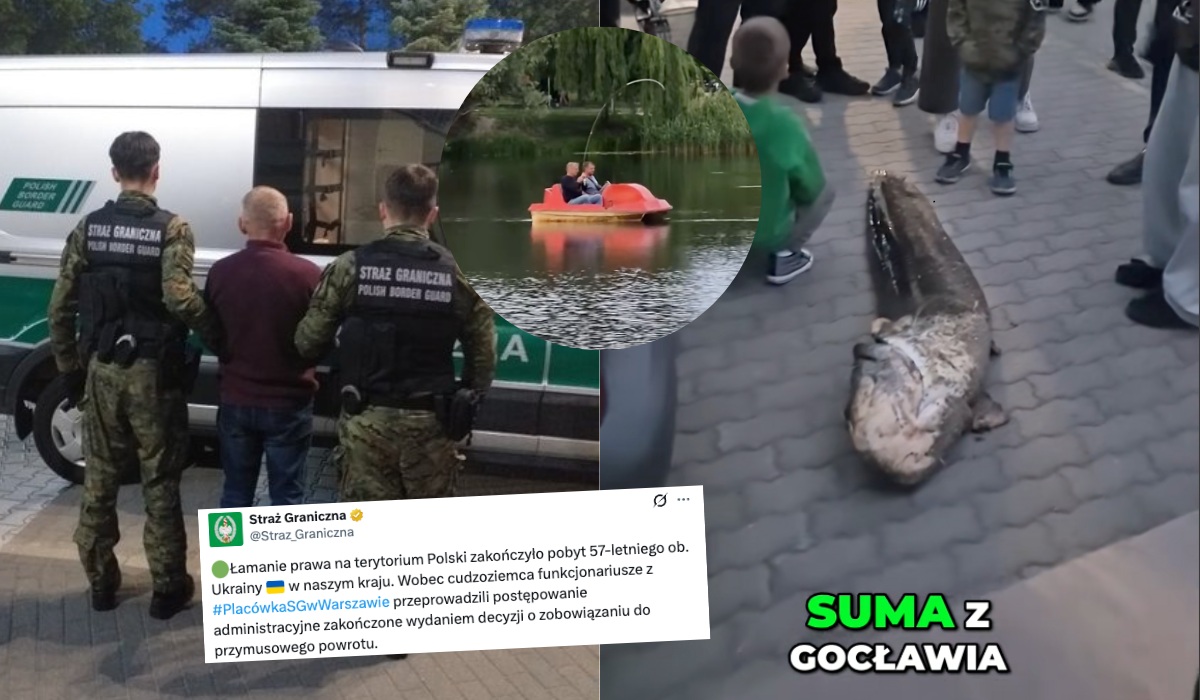

Ukrainiec, który wyłowił suma z jeziorka Balaton, został deportowany

25

Mężczyzna nie będzie mógł wrócić do Polski przez pięć lat. Zobacz więcej »

Majtczakowi bardzo źle siedzi się w areszcie, więc poskarżył się Rzecznikowi Praw Obywatelskich

30

Skarży się m.in. na jedzenie, nudę i nieprawidłowe oświetlenie. Zobacz więcej »

CBOS: zdecydowana większość Polaków popiera zakaz sprzedaży alkoholu nocą

41

87 proc. badanych uważa, że nadużywanie alkoholu w Polsce jest bardzo dużym problemem. Zobacz więcej »

Rząd przeznaczy 2 mld zł na projekt "Laboratoria sztucznej inteligencji", który trafi do szkół

30

"Wytypowaliśmy te szkoły tak, aby one były proporcjonalnie geograficznie rozproszone po całej Polsce". Zobacz więcej »